Минатата недела, Anthropic ја претстави специјализираната верзија на својот AI модел Claude Gov, наменет исклучиво за употреба во рамките на националната безбедност. Овој модел може да обработува доверливи и тајни документи и значително поретко одбива барања што вклучуваат чувствителни информации за разлика од стандардните верзии.

Claude Gov е прилагоден за работа со разузнавачки и одбранбени податоци, со подобрени јазични способности на јазици релевантни за безбедноста на САД.

Microsoft и OpenAI – лидери благодарение на GPT-4o

Во јануари 2025 година, Microsoft доби дозвола да го користи GPT-4o во рамките на Azure Government Top Secret облакот изолиран систем за обработка на најосетливите државни податоци, без пристап до интернет. Системот веќе го користат околу 10.000 припадници на американската разузнавачка заедница.

Уште во 2024 година, Microsoft претстави посебна верзија на GPT-4 развивана 18 месеци специјално за американските владини агенции. Во август, нивната услуга Azure OpenAI Service доби и FedRAMP High сертификат што овозможи напредно користење на AI во владините системи.

Meta направи исклучок за моделите Llama

Во ноември 2024 година, Meta реши да направи отстапка од својата политика за забрана на воена употреба и ги понуди моделите Llama на американските безбедносни агенции. Меѓу клиентите се Lockheed Martin, Palantir и Booz Allen Hamilton.

Meta овозможи пристап и за сојузничките држави на САД, вклучувајќи ги Велика Британија, Канада, Австралија и Нов Зеланд. Моделите Llama се користат за обработка на воено-технички документи, анализа на податоци и автоматско генерирање код.

Google развива тајна верзија на моделот Gemini

Google исто така се приклучи на трката, развивајќи посебна верзија на својот AI модел Gemini, прилагодена за работа со доверливи владини системи. Платформата Google Distributed Cloud веќе има дозвола за работа со најосетливи податоци, а партнерството со американското Воено воздухопловство (Air Force Cloud One) ја потврдува сериозноста на нивниот пристап.

Google користи безбедносна архитектура наречена Zero Trust каде што ниту еден дел од мрежата не се смета однапред за безбеден, туку секој пристап се проверува во реално време.

Компанијата Cohere, специјализирана за AI алатки во деловни процеси, соработува со Palantir на прилагодување на моделите за потребите на безбедносните структури. Palantir веќе со години работи со американските имиграциски служби и други тајни агенции, и сега се позиционира како клучен AI партнер.

Deloitte, Accenture Federal Services и други консултантски куќи исто така влегуваат на сцената, нудејќи интеграција на вештачката интелигенција во државните системи.

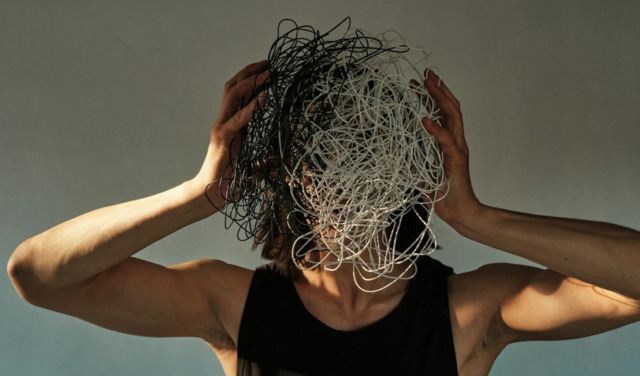

Може ли AI да „измисли“ доверливи информации?

Сериозно прашање што се поставува е феноменот на конфабулација кога AI моделите „пополнуваат празнини“ со измислени, но уверливи информации. Иако не лажат намерно, моделите засновани на веројатност може да генерираат неточни податоци ако не се користат внимателно и стручнo.

Администрацијата на Доналд Трамп воведе нови насоки кои ја охрабруваат пошироката употреба на AI во државните институции, заменувајќи го построгиот пристап на претходната власт. Според проценките, пазарот на владини AI договори моментално вреди неколку стотици милијарди долари, а се очекува до 2030 година да порасне над 800 милијарди.

Извор: web-mind.rs