Од зајаци кои скокаат на трамболини, преку „трогателни“ приказни за мајки, татковци и успехот на нивните деца, па сè до животни кои се смеат, плачат или покажуваат човечки емоции – границата меѓу реалното и вештачки создаденото станува сè понејасна.

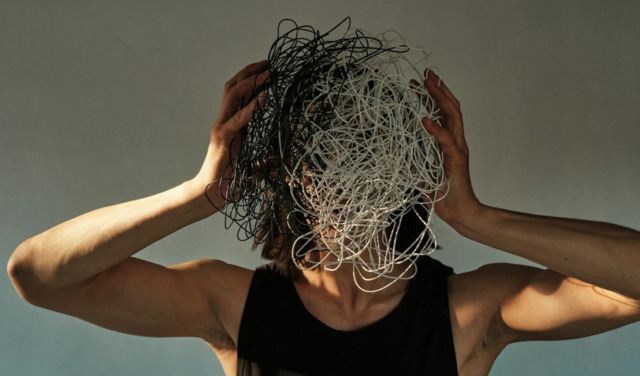

Буквално можеме да зборуваме за AI епидемија. Неверојатно е колку лесно луѓето „паѓаат“ на генерирани видеа, слики и приказни, доживувајќи ги како автентични и вистинити. Емоцијата без разлика дали станува збор за сочувство, воодушевување или тага очигледно стана најсилното оружје на алгоритмите и на оние кои ги злоупотребуваат.

Bunnies Escape and Bounce on Trampoline – Caught on Camera (Real or not? Tell me what you think)

AI епидемија

Особено загрижува трендот кој во последните месеци стана исклучително популарен на Инстаграм и ТикТок. Се креираат профили, најчесто наводно на млади жени, чии први објави прикажуваат потресни животни приказни: тешко детство, семејни трагедии, борба со сиромаштија или неправда. Публиката емотивно се врзува, дава поддршка и ја споделува содржината.

А потоа, речиси незабележливо, следува пресврт започнуваат провокативни видеа, дискретни повици за регистрација и месечни претплати за „ексклузивна содржина“, која во најголем број случаи е целосно генерирана со вештачка интелигенција.

Она што дополнително загрижува е фактот што многу корисници воопшто не сфаќаат дека се измамени. Тие не само што веруваат во тие приказни, туку и ги бранат, влегуваат во расправии и емотивно се врзуваат за дигитални илузии кои никогаш не постоеле.

Се поставува клучното прашање: како ова да се запре и каде да се повлече границата? Зашто последиците не се безизлезни. Луѓето сè повеќе ја губат способноста да ја разликуваат реалноста од конструкцијата, а довербата во визуелниот доказ – фотографија или видео – постепено се урива.

AI во служба на МВР

Како пример може да се наведе и ситуацијата што неодамна се случи во Белград, кога Министерството за внатрешни работи објави AI „доработена“ фотографија од осомничен, која речиси воопшто не личеше на вистинската личност. Со тоа јавноста беше доведена во заблуда, а процесот на информирање дополнително замаглен.

Проблемот не е само во самата употреба на вештачка интелигенција, туку во фактот дека не беше јасно нагласено дека станува збор за генерирана слика, односно за обид за „прочистување“ или апроксимација на изгледот.

Во вакви ситуации транспарентноста мора да биде апсолутна. Во спротивно, институциите самите учествуваат во нормализација на манипулацијата, што е особено опасно во контекст на безбедноста и довербата на граѓаните.

Како да препознаете AI-генерирани видеа и слики?

Иако технологијата брзо напредува, сè уште постојат знаци кои можат да помогнат во препознавање на вештачки генерирана содржина:

- Обрнете внимание на деталите – неприродни движења, чудно трепкање, неусогласени изрази на лицето или „пластична“ кожа често се првиот сигнал.

- Проверете го контекстот – ако приказната е премногу совршено спакувана за да предизвика силна емоција, веројатно целта е манипулација.

- Погледнете го профилот – нови профили, без историја или со нагли промени во содржината, често кријат AI позадина.

- Звук и говор – монотон глас, неприродна интонација или минимални грешки во изговорот можат да укажат на синтетички глас.

- Застанете пред да споделите – токму таа една пауза често е доволна за да се разбиe илузијата.

Вештачката интелигенција сама по себе не е проблем. Проблемот настанува кога се користи без јасни правила, одговорност и етички граници. Во моментот кога лажната содржина почнува да ги обликува емоциите, одлуките и ставовите на луѓето, повеќе не зборуваме за забава или иновација, туку за сериозна општествена закана.

Ако не научиме да бидеме критични, внимателни и информирани, ризикуваме да се разбудиме во свет во кој вистината повеќе не е прашање на факти, туку на квалитетот на алгоритмот. А тоа е цена која ниту едно општество не би смеело да ја плати.

Извор: web-mind.rs